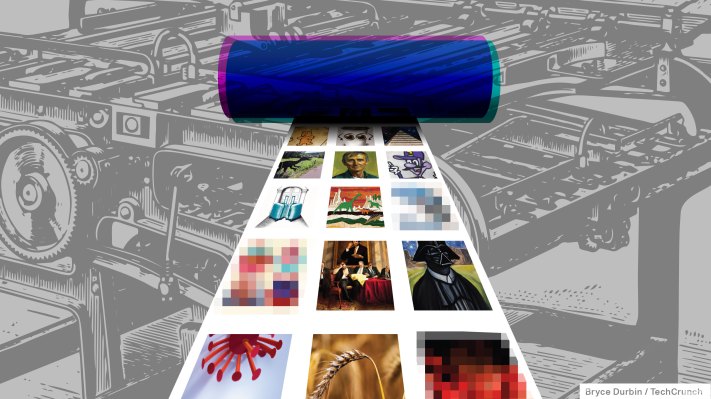

É uma maravilha o que a IA generativa, especialmente os modelos de IA de texto para imagem, como Midjourney e DALL-E 3 da OpenAI, podem fazer. Do fotorrealismo ao cubismo, os modelos de geração de imagens podem traduzir praticamente qualquer descrição, curta ou detalhada, em arte que poderia muito bem ter surgido do cavalete de um artista.

O problema é que muitos destes modelos – se não a maioria – foram treinados em obras de arte sem o conhecimento ou permissão dos artistas. E embora alguns fornecedores tenham começado a compensar artistas ou a oferecer formas de “optar por não participar” do treinamento de modelos, muitos não o fizeram.

Em vez de orientação dos tribunais e do Congresso, empresários e ativistas estão lançando ferramentas projetadas para permitir que os artistas modifiquem suas obras de arte para que não possam ser usadas no treinamento de modelos GenAI. Uma dessas ferramentas, Nightshade – lançada esta semana – faz alterações sutis nos pixels de uma imagem para induzir os modelos a pensarem que a imagem representa algo diferente do que realmente representa. Outro, Kin.artusa segmentação de imagens (ou seja, ocultando partes da obra de arte) e randomização de tags (trocando o nome de uma obra de arte metatags de imagem) para interferir no processo de treinamento do modelo.

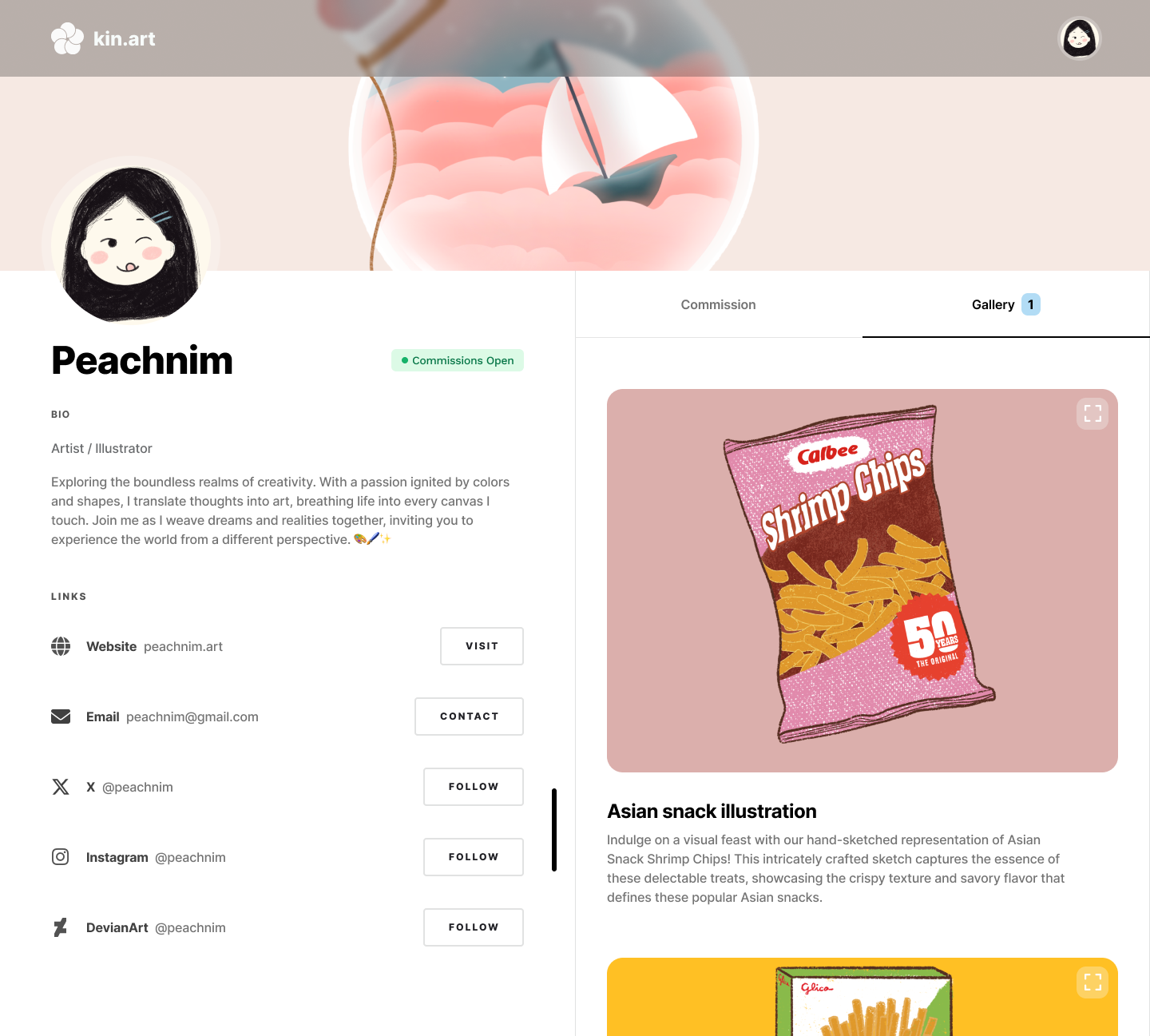

Lançada hoje, a ferramenta Kin.art foi co-desenvolvida por Flor Ronsmans De Vry, que cofundou a Kin.art, uma plataforma de gerenciamento de comissões de arte, ao lado de Mai Akiyoshi e Ben Yu há alguns meses.

Como explicou Ronsmans De Vry numa entrevista, os modelos geradores de arte são treinados em conjuntos de dados de imagens rotuladas para aprender as associações entre conceitos escritos e imagens, por exemplo, como a palavra “pássaro” pode se referir não apenas a pássaros azuis, mas também a periquitos e águias (além de noções mais abstratas). Ao “perturbar” a imagem ou os rótulos associados a uma determinada obra de arte, torna-se muito mais difícil para os fornecedores utilizar a obra de arte no treinamento de modelos, diz ele.

Um perfil de artista em Kin.art. Créditos da imagem: Kin.art

“Projetar uma paisagem onde a arte tradicional e a arte generativa possam coexistir tornou-se um dos principais desafios que a indústria da arte enfrenta”, disse Ronsmans De Vry ao TechCrunch por e-mail. “Acreditamos que isto começa com uma abordagem ética à formação em IA, onde os direitos dos artistas são respeitados.”

Ronsmans De Vry afirma que a ferramenta de combate ao treinamento do Kin.art é superior em alguns aspectos às soluções existentes porque não requer modificação criptográfica de imagens, o que pode ser caro. Mas, acrescenta, também pode ser combinado com esses métodos como proteção adicional.

Método de segmentação que derrota o modelo do Kin.art. Créditos da imagem: Kin.art

“Outras ferramentas disponíveis para ajudar a proteger contra o treinamento de IA tentam mitigar os danos depois que sua obra de arte já foi incluída no conjunto de dados por envenenamento”, disse Ronsmans De Vry. “Nós evitar que seu trabalho artístico seja inserido em primeiro lugar.”

Agora, Kin.art tem um produto para vender. Embora a ferramenta seja gratuita, os artistas precisam enviar suas obras de arte para a plataforma de portfólio Kin.art para usá-la. A ideia actual, sem dúvida, é que a ferramenta canalize os artistas para a gama de serviços de recolha e facilitação de encomendas de arte baseados em taxas da Kin.art, o seu negócio básico.

Mas Ronsmans De Vry está posicionando o esforço como principalmente filantrópico, prometendo que a Kin.art disponibilizará a ferramenta para terceiros no futuro.

“Depois de testar nossa solução em nossa própria plataforma, planejamos oferecê-la como um serviço para permitir que qualquer site pequeno e grande plataforma proteja facilmente seus dados contra uso não licenciado”, disse ele. “Possuir e ser capaz de defender os dados da sua plataforma na era da IA é mais importante do que nunca. . . Algumas plataformas têm a sorte de poder proteger seus dados, bloqueando o acesso de não usuários, mas outras precisam fornecer serviços voltados ao público e não têm esse luxo. É aqui que entram soluções como a nossa.”